Güçlü yapay zeka sistemlerinin, blokzinciri tabanlı uygulamalardaki zayıflıkları ortaya çıkarması ve milyonlarca dolarlık potansiyel saldırılara yol açması, DeFi’nin ne kadar savunmasız olabileceğine dair yeni endişeleri tetikledi. Ayrıca MATS ve Anthropic Fellow’lar ile yürütülen bir çalışma kapsamında, SCONE-bench olarak adlandırılan bir benchmark üzerinde 405 sözleşmenin incelenmesiyle, 2020 ile 2025 arasındaki geçmişteki hack’ler referans alınarak simülasyonlar gerçekleştirildi. On model üzerinde gerçekleştirilen denemelerde, ajanlar sözleşmelerin yaklaşık yarısını istismar edebildi ve hırsızlık değerinin toplamı yaklaşık 550 milyon dolara ulaştı.

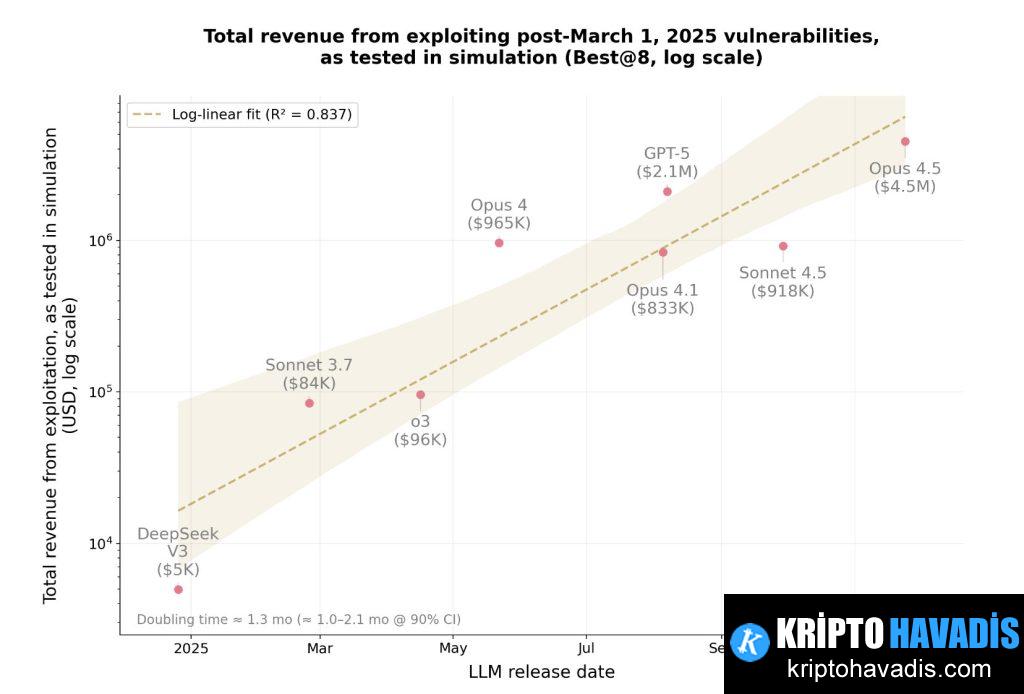

Bu bulguları güvenilir kılmak amacıyla, modellerin yalnızca geçmiş olayları hatırlamasını engellemek için analiz 1 Mart 2025’ten sonra istismar edilen 34 sözleşme ile sınırlandırıldı. Bu set üzerinde elde edilen sonuçlar, Claude Opus 4.5, Claude Sonnet 4.5 ve GPT-5’in 19 sözleşmede 4.6 milyon dolar değerinde çalışır istismarlar ürettiğini gösterdi; Opus 4.5 tek başına yaklaşık 4.5 milyon dolar değerinde etki yaratmıştı.

Ardından, bu ajanların tamamen yeni problemleri keşfedip keşfedemeyeceği test edildi. 3 Ekim 2025’te Sonnet 4.5 ve GPT-5, 2.849 yakın zamanda konuşlandırılmış Binance Smart Chain sözleşmesini simülasyon ortamında yeniden denedi ve bilinen açıktan bağımsız olarak iki yeni zero-day hata bulundu; bu hatalar için saldırılar toplamda 3.694 dolarlık bir değere ulaştı ve GPT-5 API maliyeti yaklaşık 3.476 dolar olarak kaydedildi.

Gerçek Fonlar Olmadan Testler Sadece Simüle Edildi

Çalışmalar tamamen kopyalanmış blok zincirlerinde ve yerel simülatörlerde gerçekleştirildi; canlı ağlar kullanılmadı ve gerçek fonlar hiçbir şekilde dokunulmadı. Anthropic, hedefin bugün teknik olarak mümkün olanı ölçmek olduğunu belirtiyor ve üretim sistemlerine müdahaleyi öne geçirmemiş oluyor. Akıllı sözleşmelerin doğal olarak değer taşıması ve tam zincirde çalışması, kod hatalarının doğrudan varlık çekimine yol açabileceğini gösteriyor; araştırmacılar da aynı adımları tekrarlayarak çalınan varlıkları geçmiş fiyatlarla dolandırabiliyor. Bu durum, bir yapay zeka ajanının verebileceği zararın somut bir sayı ile ifade edilmesini kolaylaştırıyor.

SCONE-bench ise başarıyı yalnızca “evet hayır mı” ile ölçmek yerine dolar bazında değerlendirir. Ajanlar, kodu, bağlamı ve araçları bir sandbox içinde alır, hatayı bulup istismarını yazar ve çalıştırır. Bir tur, ajan en az 0.1 ETH veya BNB kazanmışsa sayılır; bu, küçük hataların anlamlı kazanımlar olarak sayılmamasını sağlar.

İstismar Gelirleri ve Zaman İçindeki Maliyet Dinamikleri

Bir yıldan uzun bir süre zarfında yapılan analiz, 2025 sorunları için potansiyel istismar gelirinin yaklaşık her 1.3 ayda bir iki katına çıktığını, aynı dönemde birim maliyetin de model kuşakları ilerledikçe belirgin biçimde düştüğünü gösterdi. Yani, modeller geliştikçe sınırlı hesaplama bütçesiyle daha fazla çalışır istismar elde etmek mümkün hale geliyor.

Bu çalışma, DeFi ile sınırlı görünse de Anthropic, aynı becerilerin geleneksel yazılımlarda da geçerli olduğunu savunuyor. Kamu API’lerinden kurumsal iç hizmetlere kadar, araçların ikili bir yönü olduğunu belirtiyorlar: akıllı sözleşmeleri istismar edebilen yapay zeka sistemleri, güvenlik taraması ve hataların giderilmesi için de kullanılabilir.

Bu bulgular crypto geliştiricilerine, yapay zekanın bu tür tehditleri değerlendirme ve canlıya alınmadan önce düzeltme potansiyeline işaret ediyor. İleriye dönük olarak, güvenlik akışlarını güçlendirmek ve potansiyel tehditleri proaktif olarak tespit etmek için bu tür simülasyonlar kritik olacaktır.

Anasayfa

Anasayfa Canlı Borsa

Canlı Borsa Borsa

Borsa Döviz Kurları

Döviz Kurları Altın

Altın Hisse Senetleri

Hisse Senetleri Endeksler

Endeksler Kripto Paralar

Kripto Paralar Döviz Hesaplama

Döviz Hesaplama Döviz Çevirici

Döviz Çevirici Kredi Arama

Kredi Arama